一、开篇引入:为什么2026年每个开发者都绕不开AI拟人助手?

2026年4月,AI拟人助手正站在技术浪潮的中心。从CES 2026上雷蛇发布的全息AI伴侣Project Ava,到GitHub上以病毒速度蔓延的“.skill”人物蒸馏项目,再到2026年被MIT Technology Review列为年度突破性技术的AI陪伴赛道,全球开发者社区正在经历一场前所未有的变革-43。

太多开发者面临着同一个窘境:只会调用API,不懂底层原理;遇到角色不一致就束手无策;面试时被问到记忆机制就只能支支吾吾。本文将系统拆解AI拟人助手的技术架构,从核心概念到代码示例,从底层原理到高频面试题,帮你建立完整知识链路。

二、痛点切入:传统聊天机器人为何不够“像人”?

先来看一段传统实现的关键代码:

传统聊天机器人 - 基于关键词匹配 def traditional_chat(user_input): if "天气" in user_input: return "今天天气晴朗,气温24度。" elif "你好" in user_input: return "你好,有什么可以帮你的吗?" elif "再见" in user_input: return "再见!" else: return "抱歉,我没理解你的意思。"

这段代码暴露了三大核心痛点:

缺乏记忆:每次对话都是全新的开始,用户上一句说过“我叫小明”,下一句问“我叫什么”就答不上来。

缺乏一致性:没有角色人格绑定,无法区分“我是客服”和“我是朋友”两种模式下的回应风格。

缺乏上下文连贯:无法捕捉对话历史中的逻辑关联,回答机械生硬。

AI拟人助手的诞生,正是为了解决这些根本性问题。

三、核心概念讲解:AI拟人助手

标准定义:

AI拟人助手(Artificial Intelligence Anthropomorphic Assistant)是指融合大语言模型(Large Language Model, LLM)、多模态感知与表达、长期记忆管理等技术,具备类人交互能力、角色人格一致性和上下文连续性的智能对话系统。

拆解关键词:

拟人(Anthropomorphic) :赋予AI系统以人类特质——包括对话风格、情感表达、人格一致性,而非简单地“回答问题”。

助手(Assistant) :强调服务导向,从客服、教育、陪练到情感陪伴,服务于具体场景和用户需求。

大语言模型驱动(LLM-powered) :区别于传统的检索式或规则式系统,底层依靠Transformer架构的生成能力实现自然对话。

生活化类比:

如果把传统聊天机器人比作一台自动售货机——你投币(输入指令),它出货(固定回复);那么AI拟人助手更像一个有“个性”的餐厅服务员——他能记住你是“常客”、知道你爱喝什么、会根据你的心情调整说话方式,甚至在你难过时主动递上一杯温水。

核心价值:AI拟人助手让机器从“工具”进化为“伙伴”,解决了人机交互中的信任感、情感连接和长期协作难题-45。

四、关联概念讲解:角色人格设定

标准定义:

角色人格设定(Character Persona Configuration / Role Setting)是指通过系统提示词(System Prompt)、角色特征嵌入(Role Feature Embedding, RFE)和微调技术,为AI拟人助手定义并固化一套可识别、可延续的人格参数体系,包括身份背景、说话风格、价值观倾向和知识边界-58。

与核心概念的关系:

角色人格设定是实现AI拟人助手的具体手段

AI拟人助手是角色人格设定的最终呈现载体

差异对比:

| 维度 | AI拟人助手 | 角色人格设定 |

|---|---|---|

| 定位 | 目标 / 结果 | 方法 / 工具 |

| 内涵 | 完整交互系统 | 人格参数配置 |

| 示例 | 雷蛇Project Ava中的Kira角色 | 定义Kira的“TikTok电子女孩”人设参数-11 |

运行机制示例:

极简角色人格设定示例 persona_config = { "name": "Kira", "role": "游戏助手", "traits": {"extroversion": 0.9, "humor": 0.7, "professionalism": 0.8}, "style": "热情活泼,喜欢用颜文字,擅长游戏装备推荐" } def chat_with_persona(user_input, persona_config): 实际生产中通过system prompt注入LLM prompt = f"你现在是{persona_config['name']},{persona_config['style']}。用户说:{user_input}" 调用LLM生成带人格特征的回复 return generate_response(prompt)

五、概念关系与区别总结

一句话总结:AI拟人助手是“目的”,角色人格设定是“手段”——没有后者的精确配置,前者只是一具空壳。

逻辑关系图:

目标层: AI拟人助手(完整智能体) ↑ 实现层: 角色人格设定 + 记忆管理 + 多模态交互 + 实时推理引擎

易混淆点:很多人把“AI拟人”等同于“AI聊天”,但实际上,AI拟人助手还涵盖了记忆系统(短时/长时记忆分层)、情感建模(情绪识别与表达)、多模态感知(语音+视觉)等维度-21。

六、代码/流程示例:构建一个具有记忆的AI拟人助手

以下是一个极简但完整的AI拟人助手核心实现:

AI拟人助手极简实现 - 含记忆与角色设定 import json from typing import List, Dict class AIAnthropomorphicAssistant: def __init__(self, persona_name: str, persona_style: str): 角色人格设定 self.persona_name = persona_name self.persona_style = persona_style 长期记忆存储 self.long_term_memory = [] 结构化记忆(事实+偏好) self.conversation_history = [] 会话上下文 def remember(self, fact: str): """记录用户信息到长期记忆""" self.long_term_memory.append(fact) print(f"[记忆] {self.persona_name} 记住了: {fact}") def build_prompt(self, user_input: str) -> str: """构建带人格和记忆的Prompt""" 1. 角色人格注入 persona_context = f"你是{self.persona_name},{self.persona_style}。" 2. 长期记忆注入 memory_context = "" if self.long_term_memory: memory_context = "关于用户,你记得:" + "; ".join(self.long_term_memory[-5:]) 3. 短期会话上下文 history_context = "" if self.conversation_history: recent = self.conversation_history[-4:] history_context = "对话历史:" + "\n".join(recent) full_prompt = f"{persona_context}\n{memory_context}\n{history_context}\n用户: {user_input}\n{self.persona_name}:" return full_prompt def chat(self, user_input: str) -> str: """执行一次对话""" prompt = self.build_prompt(user_input) 实际生产中调用LLM API(如调用GPT-4/Grok/Qwen) response = self.call_llm(prompt) 示意调用 记录会话历史 self.conversation_history.append(f"用户: {user_input}") self.conversation_history.append(f"{self.persona_name}: {response}") 关键步骤:从对话中提取值得记忆的信息 if "我叫" in user_input: name = user_input.split("我叫")[-1].strip() self.remember(f"用户的名字是{name}") return response def call_llm(self, prompt: str) -> str: """LLM调用示意 - 生产环境替换为实际API""" 此处在真实场景中调用OpenAI/Anthropic/智谱等API return f"[模拟回复] 理解:{prompt[:50]}... → 生成拟人化回应"

关键步骤标注:

Line 9-12:角色人格初始化,注入AI拟人助手的基础人设

Line 14-18:长期记忆存储,实现“越聊越懂你”

Line 20-37:Prompt构建,将记忆与人格整合输入LLM

Line 45-47:关键信息自动提取并固化到长期记忆

对比新旧实现:

| 维度 | 传统实现 | AI拟人助手实现 |

|---|---|---|

| 记忆机制 | ❌ 无记忆 | ✅ 长期记忆+短期上下文 |

| 人格一致性 | ❌ 每次重置 | ✅ 角色设定固化 |

| 交互体验 | ❌ 机械问答 | ✅ 连贯自然 |

| 个性化 | ❌ 千人一面 | ✅ 自适应记忆 |

七、底层原理/技术支撑

AI拟人助手的三大底层技术基石:

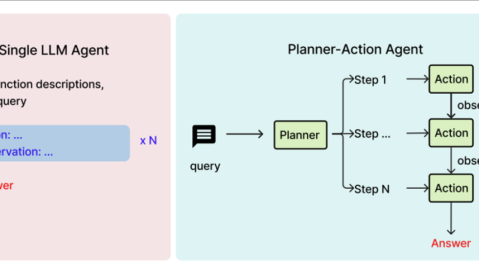

1. 大语言模型(LLM)与Transformer架构

2026年2月,Anthropic提出了角色选择模型(Persona Selection Model, PSM) ,指出LLM在预训练阶段通过海量人类文本学会了“扮演”能力,像一个“数字演员”;而后训练(RLHF等)则是一个“选角与定型”的过程-23。正是这一原理,让AI拟人助手的角色扮演从“硬编码”变成了“概率分布上的自然涌现”。

2. 长期记忆机制(Long-term Memory)

2026年4月,MemMachine等记忆系统实现了短时、长时情景与人格档案的整合存储-49;矩阵起源在GTC 2026上开源的Memoria,则引入了Copy-on-Write技术让AI记忆变得可回溯、可管理-50。AI拟人助手的“记得住”能力,正是靠这些底层记忆框架实现的。

3. 多模态感知与实时渲染

融合ASR(语音识别)、NLU(自然语言理解)、TTS(语音合成)与深度学习驱动模型,将语音信号映射为唇形、表情和身体动作-22。这是AI拟人助手从“文字对话”升级为“全息交互”的关键工程能力。

八、高频面试题与参考答案

Q1:AI拟人助手与传统聊天机器人的核心区别是什么?

参考答案:记忆 + 人格 + 上下文。 传统机器人基于规则或关键词匹配,无状态、无记忆;AI拟人助手基于LLM,具备长期记忆存储、角色人格设定和对话历史上下文理解能力,可实现跨会话的个性化交互。

Q2:如何让AI拟人助手保持角色人格一致性?

参考答案:三管齐下——(1) System Prompt注入:在每次调用LLM时注入角色设定;(2) 微调(Fine-tuning) :用目标角色风格的对话数据训练模型;(3) RLHF选角:通过人类反馈强化学习固化和提纯目标人格。Anthropic的PSM理论指出,后训练本质上就是“选角”过程-23。

Q3:AI拟人助手的记忆机制如何设计?

参考答案:分层记忆架构。短期内存存储当前会话上下文;长期内存存储用户画像、事实偏好和跨会话情景;通常采用RAG(检索增强生成)结合向量数据库实现高效检索。2026年的前沿方案如MemMachine引入了“真相留存”架构,通过保留完整情景记录替代有损的LLM压缩提取-49。

Q4:什么是Anthropic的角色选择模型(PSM)?

参考答案:PSM是Anthropic在2026年2月提出的解释LLM拟人化行为的理论框架。它将底层LLM与AI助手角色区分开——预训练让LLM学会“扮演”所有可能人格,后训练则是一个“选角”过程,固化出安全的官方助手形象。这一理论解释了为何AI助手既表现出类人特质又偶尔犯低级错误-23。

Q5:如何评估AI拟人助手的拟人化程度?

参考答案:可从四个维度评估——人格一致性(同一角色在不同对话中的稳定程度)、记忆准确性(对用户信息的正确回忆率)、上下文连贯性(多轮对话的逻辑流畅性)、情感表达自然度(语音、表情与情绪的匹配度)。业界已有LOCOMO、PersonaMem等基准测试集-48。

九、结尾总结

回顾全文,我们厘清了AI拟人助手与角色人格设定的关系、通过代码示例展示了记忆与人格的整合方式、了解了底层LLM与记忆机制的支撑原理,并准备了5道高频面试题。

核心知识点回顾:

✅ AI拟人助手是融合人格设定+长期记忆+多模态交互的完整系统

✅ 角色人格设定是实现拟人助手的关键手段

✅ 底层依赖LLM的PSM机制和分层记忆架构

✅ 代码实现的核心是Prompt工程 + 记忆管理 + LLM调用

易错点提醒:不要混淆“AI拟人助手”和“AI角色扮演”——前者强调助手的功能性服务(客服、教育、陪伴),后者更偏叙事创作(虚构角色对话)。两者技术上相通,但产品定位不同。

进阶预告:下一篇将深入AI拟人助手的记忆系统实战——从向量数据库选型到RAG性能调优,再到MemMachine等开源框架的落地部署。敬请期待。

本文数据截至2026年4月9日,市场数据来源于中商产业研究院、解数咨询、QYResearch等机构公开报告,技术原理参考自阿里云开发者社区、arXiv、Anthropic官方博客等权威渠道。