本文目标读者:技术入门/进阶学习者、在校学生、面试备考者、相关技术栈开发工程师

文章定位:技术科普 + 原理讲解 + 代码示例 + 面试要点,兼顾易懂性与实用性

开篇引入

在AI技术加速落地的2026年,飞天助手AI作为一款集成多项智能功能的辅助工具,正成为个人效率提升与企业数字化运营的重要利器。很多开发者和学习者在面对这类AI智能工具时,普遍存在一个困境:会用但不懂原理,被问及底层机制时答不上来,面试中被问到“智能助手如何实现意图识别”或“多模态数据处理流程”时束手无策。

本文将从飞天助手AI的产品定位出发,层层拆解其背后的核心技术——从基础概念到底层原理,从痛点分析到代码演示,再到高频面试考点梳理,帮助读者建立一条完整的技术认知链路。无论你是技术入门者、面试备考者,还是正在研发相关产品的工程师,本文都将为你提供体系化的知识框架与可落地的实战参考。

一、痛点切入:为什么我们需要飞天助手AI这样的智能工具?

传统方式的局限

在过去,要完成一个“智能文件分类”或“语音日程提醒”功能,开发者往往需要分别调用多个独立的API:文件管理系统一套、语音识别系统一套、日程提醒系统一套,代码冗余且耦合度高。以下是一个典型的传统实现思路:

传统实现方式:功能碎片化,代码高度耦合 def traditional_workflow(): 1. 文件分类:手动或基于简单规则 files = os.listdir("./downloads") for file in files: if file.endswith((".jpg", ".png")): shutil.move(file, "./images/") elif file.endswith((".mp4", ".avi")): shutil.move(file, "./videos/") 2. 语音识别:调用独立SDK import speech_recognition as sr recognizer = sr.Recognizer() 3. 日程管理:另一套独立实现 schedule.add_event("会议", "10:00")

传统方式的三大痛点:

功能割裂,集成困难:文件管理、语音识别、日程提醒各自为政,用户需要在多个应用间频繁切换-39。

缺乏智能化:文件分类依赖文件名后缀或简单规则,无法实现基于内容语义的智能归类。

可扩展性差:新增一个功能模块意味着大量重复的API对接工作,代码复用率低。

飞天助手AI的设计初衷

飞天助手AI正是为解决上述问题而设计——它通过集成AI技术与云端能力,将文件管理、系统优化、智能提醒、跨平台同步等功能有机融合-1,为用户提供一体化的智能服务体验。其核心价值在于:用一个统一的AI智能体,覆盖用户日常办公与生活的多样化场景。

二、核心概念讲解:飞天助手AI的智能交互系统

概念A:多模态智能交互

定义:多模态智能交互(Multimodal Intelligent Interaction)是指系统能够同时处理和理解多种类型的人类输入信号——包括语音、文字、图像和行为数据——并做出统一、连贯的响应。

飞天助手AI的核心AI引擎采用多模态学习架构,能同时处理语音、图像和行为数据,实现精准的用户画像构建-5。例如,当用户说“帮我整理一下今天下载的东西”时,系统不仅识别语音指令,还能结合文件元数据(下载时间、文件类型)和行为历史,智能完成分类整理。

生活化类比:多模态智能交互就像一个全能的私人助理——他能听懂你的口头指令(语音识别)、看懂你写的便条(文字识别)、观察你的表情动作(行为分析),然后综合所有信息给出最恰当的回应,而不是只听只言片语就做出片面判断。

概念B:情境感知系统

定义:情境感知(Context-Awareness)是指系统能够自动识别用户当前所处的环境场景(如办公、驾驶、居家),并据此智能切换界面布局、功能策略和服务模式。

飞天助手AI创新的情境感知系统可自动识别用户所处场景,智能切换办公模式、驾驶模式等专属界面-5。

概念A与概念B的关系:

多模态智能交互是“感知层” ——负责收集和理解用户的多种输入信号

情境感知是“决策层” ——基于感知到的信息,判断当前场景并做出响应策略

一句话概括:多模态交互是飞天助手AI的“感官”,情境感知是它的“大脑”。

| 对比维度 | 多模态智能交互 | 情境感知系统 |

|---|---|---|

| 定位 | 输入处理与理解 | 场景识别与决策 |

| 处理对象 | 语音、图像、文本、行为数据 | 场景上下文(时间、地点、设备状态等) |

| 输出 | 语义解析结果、用户意图 | 场景标签、适配策略 |

| 类比 | 耳朵+眼睛 | 大脑决策中枢 |

三、代码/流程示例:飞天助手AI的智能文件分类实战

下面通过一个简化的代码示例,展示飞天助手AI如何实现AI智能文件分类功能。飞天助手2026最新版新增了该功能,能够自动识别并整理文档、图片和视频-1。

飞天助手AI智能文件分类核心逻辑简化示例 import os import shutil from transformers import pipeline 使用预训练多模态模型 class FlyAssistantAI: def __init__(self): 初始化多模态分类模型(模拟飞天助手AI的智能分类引擎) self.classifier = pipeline("image-classification", model="microsoft/resnet-50") def intelligent_file_sort(self, target_dir): """ 智能文件分类核心方法 流程:扫描目录 → 提取特征 → AI分类 → 自动归档 """ for filename in os.listdir(target_dir): file_path = os.path.join(target_dir, filename) 关键步骤1:多模态特征提取 if filename.endswith(('.jpg', '.png')): 调用AI模型进行内容识别 result = self.classifier(file_path) category = result[0]['label'] 如 'cat', 'dog', 'document' 关键步骤2:智能归档 target_folder = self._map_category_to_folder(category) shutil.move(file_path, f"./sorted/{target_folder}/") elif filename.endswith(('.mp4', '.mov')): 视频文件:提取关键帧+内容分析 self._process_video(file_path) def _map_category_to_folder(self, category): """场景适配:根据识别结果映射到目标文件夹""" category_map = { 'cat': '宠物', 'dog': '宠物', 'document': '文档', 'screenshot': '截图' } return category_map.get(category, '其他') 执行示例 assistant = FlyAssistantAI() assistant.intelligent_file_sort("./downloads/") 执行后效果:图片自动按内容分类归档至宠物/文档/截图等文件夹

执行流程解析:

扫描阶段:遍历目标目录中的所有文件

特征提取阶段:根据文件类型(图片/视频/文档)调用对应的AI模型进行内容识别

分类决策阶段:模型输出识别标签(如“猫”“文档截图”),映射到预定义文件夹

执行归档阶段:自动将文件移动到对应分类文件夹

对比传统基于文件名后缀的简单分类,飞天助手AI实现了基于内容语义的智能分类,分类准确率和用户体验均有显著提升。

四、底层原理/技术支撑

飞天助手AI的智能化能力,底层依赖以下关键技术支持:

1. 多模态大模型(Multimodal LLM)

多模态智能交互的核心在于多模态大模型——它能够同时处理文本、图像、音频等多种模态的数据,并在统一语义空间中完成对齐与理解。飞天助手AI基于此类模型实现语音指令理解、图像内容识别和用户行为预测。

2. 神经网络加速技术

飞天助手2025手机版的AI语音助手2.0引入了神经网络加速技术,响应延迟低至0.3秒,支持连续对话和上下文关联-5。这得益于模型量化、算子融合等推理优化手段。

3. 跨平台同步架构

飞天助手AI支持Windows、macOS、Android、iOS多平台无缝同步,底层依赖云端数据同步框架和设备间状态一致性协议,确保用户在不同设备上获得一致体验-1。

💡 关于多模态大模型的更多底层原理(Transformer架构、跨模态对齐机制等),将在后续进阶文章中深入讲解,欢迎持续关注。

五、高频面试题与参考答案

以下是飞天助手AI及相关智能助手技术方向的高频面试题,附参考答案与踩分点解析:

Q1:请解释多模态智能交互的核心原理,并举例说明。

参考答案要点:

多模态交互的核心是将文本、图像、语音等不同模态数据映射到统一的语义空间

通过跨模态注意力机制实现不同模态信息之间的对齐与融合

最终输出统一的语义理解结果,用于驱动下游任务(如文件分类、日程管理)

举例:飞天助手AI的多模态学习架构可同时处理语音指令和图像数据,实现“用户说‘整理这个’+摄像头拍到文件”的联合理解-5

踩分点:语义对齐、跨模态融合、具体应用场景、技术术语准确性

Q2:智能助手的意图识别是如何实现的?

参考答案要点:

意图识别是自然语言理解(NLU)的核心任务,目标是判断用户输入背后的“目的”

常见方法包括:基于规则匹配、基于分类模型(如BERT微调)、基于大模型Prompt

实现流程:用户输入 → 分词/编码 → 特征提取 → 分类器预测意图标签 → 触发对应业务逻辑

现代智能助手(如飞天助手AI)往往采用大模型+Few-shot Prompt方案,仅需少量示例即可泛化到新场景

踩分点:定义清晰、方法分类、流程描述、对比说明(传统vs现代)

Q3:多模态大模型在智能助手中面临哪些工程挑战?如何应对?

参考答案要点:

| 挑战 | 应对策略 |

|---|---|

| 推理延迟高 | 模型量化、算子融合、边缘端部署神经网络加速器-5 |

| 跨模态对齐不准确 | 使用大规模图文/音文预训练数据,强化对比学习 |

| 设备资源受限 | 云端+边缘混合推理架构,轻量级模型端侧部署 |

| 多轮对话上下文管理 | 引入记忆机制(短期记忆+长期记忆向量库) |

踩分点:问题识别的全面性、解决方案的针对性、对实际产品的理解

Q4:飞天助手AI的情境感知系统如何实现场景识别?

参考答案要点:

情境感知系统通过融合多维度数据识别用户场景:时间、地理位置、设备状态(加速度计/陀螺仪)、应用使用历史、蓝牙/WiFi信号等

识别流程:多源数据采集 → 特征工程 → 场景分类模型 → 策略适配

实例:当检测到手机连接车载蓝牙且处于行驶状态时,自动切换至驾驶模式,界面放大按键、简化操作层级-5

踩分点:数据来源说明、流程清晰、落地实例佐证

Q5:传统功能应用与AI驱动的智能助手(如飞天助手)在设计理念上有何本质区别?

参考答案要点:

传统应用:功能导向,用户主动操作触发特定功能;功能模块独立,彼此耦合松散

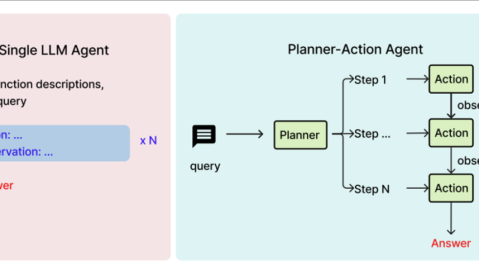

AI智能助手:任务导向,用户以自然语言表达意图,系统自主拆解任务、调度能力完成;功能模块有机融合,统一由AI大脑驱动

一句话总结:传统应用是“工具箱”,AI助手是“数字员工”——你告诉它“做什么”,它自己思考“怎么做”

踩分点:对比维度清晰(触发方式、交互模式、模块关系)、提炼核心差异、总结精炼

六、结尾总结

核心知识点回顾

本文围绕飞天助手AI,系统梳理了以下核心内容:

痛点分析:传统功能应用存在功能割裂、缺乏智能化、扩展性差三大问题,飞天助手AI通过一体化智能设计给出解决方案

核心概念:

多模态智能交互:同时处理语音、图像、行为数据,实现统一语义理解

情境感知系统:自动识别场景,智能切换服务模式

代码实战:通过AI智能文件分类的简化示例,直观展示了多模态模型的实际应用流程

底层技术:多模态大模型、神经网络加速、跨平台同步架构构成三大支撑

面试考点:意图识别、多模态挑战、情境感知等高频问题的规范答题框架

重点与易错点提示

⚠️ 易混淆点:多模态交互≠单纯的语音识别——前者是多种输入模态的融合理解,后者只是单一模态处理

⚠️ 面试避坑:回答意图识别时不要只说“用大模型”,需讲清楚实现流程和与传统方法的差异

⚠️ 工程要点:智能助手的工程难点不在于单一能力实现,而在于多种能力的协同调度与上下文管理

预告

下一篇将深入讲解飞天助手AI的多模态大模型底层原理——从Transformer架构到跨模态注意力机制,从训练数据构造到推理优化策略,适合有志于深入AI研发的同学。欢迎持续关注本系列更新。

📌 参考资料:本文部分数据与功能描述参考自飞天助手官方介绍及公开技术资料-1-5-39。