北京时间 2026年4月10日

通过 AI答题助手 的开发实践,深度解析Spring AI Alibaba集成DeepSeek模型的核心原理与工程落地。

一、开篇引入

在Java企业级AI应用开发领域,Spring AI Alibaba正逐渐成为技术选型中的核心角色。作为Spring官方AI框架的阿里云落地版本,Spring AI Alibaba基于Spring AI构建,深度融合阿里云百炼平台(DashScope),为Java开发者提供了高层次的AI API抽象与云原生基础设施集成方案,旨在帮助开发者快速构建企业级智能应用-18。2026年,Spring AI Alibaba已迭代至1.1.2.0版本,底层Spring AI升级至1.1.2,并带来了Agent Skills支持、多智能体并行执行、Graph并行条件边与异步工具执行等核心能力升级-48。

很多开发者在接触这项技术时存在明显的“会调但不深、会用但不懂”现象——只知道引入spring-ai-starter-model-deepseek依赖就能调用大模型,却对Spring AI的统一抽象层如何实现、ChatModel与ChatClient的区别是什么、底层依赖什么机制等核心问题一问三不知。面试时被问及“Spring AI如何兼容不同厂商的AI模型”,往往只能答出“通过starter切换”这种浅层答案。

本文将从零开始,带你完成从环境搭建到智能AI答题助手开发的全流程,深入剖析Spring AI Alibaba与DeepSeek集成的底层原理,并提炼高频面试考点,真正做到“会写代码、懂原理、能面试”。

本文结构如下:痛点切入分析传统AI集成的三大困境 → 核心概念讲解拆解ChatModel与ChatClient → 概念关系对比梳理Spring AI与Spring AI Alibaba的关系 → 代码实战演示AI答题助手的完整实现 → 底层原理剖析揭示自动配置机制 → 高频面试题提炼踩分点 → 总结预告。

二、痛点切入:为什么需要Spring AI

在没有Spring AI框架之前,团队通常直接对接模型厂商SDK,会遇到以下典型问题-2:

1. 接口不统一,切换成本高。 不同AI厂商的API规范、请求/响应格式各不相同,每接入一个新模型就需要重新学习一套接口协议。一旦业务要求从OpenAI切换至DeepSeek,意味着大范围重构代码。

2. 功能重复造轮子。 Prompt管理、消息封装、流式输出、工具调用(Tool Calling)、结构化输出(Structured Output)、RAG(Retrieval-Augmented Generation,检索增强生成)等通用能力,每个项目都需要从零实现一遍,代码耦合严重且难以复用。

3. 厂商锁定,迁移困难。 代码中充斥着厂商SDK特有的类型和方法,迁移成本极高。产品经理今天说“先用OpenAI”,明天说“下个月换Claude,年底可能用Gemini”,这种频繁变动对开发团队是巨大的灾难。

一个对比示例直观展示问题:

// ❌ 传统方式:直接调用厂商API(以OpenAI为例) // 代码与OpenAI强耦合,切换DeepSeek需完全重写 String url = "https://api.openai.com/v1/chat/completions"; HttpRequest request = HttpRequest.newBuilder() .uri(URI.create(url)) .header("Authorization", "Bearer " + apiKey) .header("Content-Type", "application/json") .POST(HttpRequest.BodyPublishers.ofString( "{\"model\":\"gpt-3.5-turbo\",\"messages\":[{\"role\":\"user\",\"content\":\"" + question + "\"}]}" )) .build(); String response = HttpClient.newHttpClient().send(request, BodyHandlers.ofString()).body(); // ✅ Spring AI方式:统一抽象,一行切换模型 // 无论底层是OpenAI还是DeepSeek,调用方式完全一致 String answer = chatClient.prompt().user(question).call().content();

核心价值提炼:Spring AI提供了一个JDBC式的统一抽象层——就像JDBC让Java开发者用一套API操作不同数据库一样,Spring AI让开发者用一套API调用不同AI模型-10。在生产环境中,Spring AI更像“大模型接入中间层”,而不是简单的SDK-2。

三、核心概念讲解:ChatModel

3.1 标准定义

ChatModel(对话模型接口) 是Spring AI框架中最核心的顶层接口,定义了与任何AI大语言模型进行对话交互的标准协议。不同厂商的AI服务各自提供Starter依赖和自动配置类来实现该接口-19。

3.2 关键词拆解

Chat:表示这是一个“对话型”的能力,即一问一答式的交互,区别于Embedding(文本向量化)或Image Generation(图像生成)等其他AI能力。

Model:强调这是对“AI模型”这一能力的抽象封装,而非对具体API端点的直接映射。

3.3 生活化类比

把ChatModel想象成万能充电口。你不需要关心墙里接的是火电、水电还是核电,只需要把充电线插进去就能给手机充电。同样地,你的业务代码里注入的是ChatModel接口,底层具体用的是DeepSeek、通义千问还是OpenAI,完全由配置文件决定。

3.4 核心方法

ChatModel提供了两类核心方法:

| 方法 | 类型 | 说明 |

|---|---|---|

call(String message) | 同步调用 | 发送消息,等待模型生成完整回复后返回 |

stream(String message) | 流式调用 | 以流式方式返回,模拟“打字机效果”,优化用户体验 |

流式调用底层依赖Reactor响应式编程框架,通过Flux对象实现异步非阻塞的流式输出-10。

四、关联概念讲解:ChatClient

4.1 标准定义

ChatClient(对话客户端) 是Spring AI在ChatModel之上构建的高级封装,提供了更加便捷的对话管理能力,包括系统提示词(System Prompt)预设、多轮对话记忆管理、日志记录、增强链(Advisor)等功能-11。

4.2 与ChatModel的关系

如果用汽车来类比:ChatModel是发动机,ChatClient是整车。发动机提供了最核心的动力,但整车增加了方向盘、刹车、空调等便捷功能,让驾驶体验更友好。同样地,ChatClient封装了ChatModel,同时提供:

默认系统提示词:通过

.defaultSystem()预设AI的“人设”和行为约束记忆管理:通过

MemorySaver实现多轮会话上下文记忆Advisor增强链:可插拔的增强机制,支持日志记录、RAG检索增强、敏感词过滤等

4.3 使用示例对比

// 方式一:直接使用 ChatModel(底层方式,灵活但需要自行处理消息结构) @Resource private ChatModel chatModel; public String askRaw(String question) { UserMessage userMsg = new UserMessage(question); ChatResponse response = chatModel.call(new Prompt(List.of(userMsg))); return response.getResult().getOutput().getContent(); } // 方式二:使用 ChatClient(推荐,企业级开发标准) @Service public class AIService { private final ChatClient chatClient; public AIService(ChatClient.Builder builder) { this.chatClient = builder .defaultSystem("你是专业的AI答题助手,擅长解答技术问题,回答要准确、清晰、有条理。") .build(); } public String ask(String question) { // 一行代码完成调用,自动处理消息封装和响应解析 return chatClient.prompt().user(question).call().content(); } }

五、概念关系与区别总结

| 维度 | Spring AI | Spring AI Alibaba |

|---|---|---|

| 定位 | Spring官方AI框架的标准接口规范 | Spring AI在阿里云平台的落地实现 |

| 类比 | JDBC规范 | MySQL驱动 |

| 提供内容 | 抽象接口(ChatModel、ChatClient等) | 具体Starter、自动配置、DashScope适配 |

| 依赖方式 | spring-ai-bom + spring-ai-starter-model- | spring-ai-alibaba-bom + spring-ai-alibaba-starter-dashscope |

一句话概括:Spring AI定义了“做什么”,Spring AI Alibaba实现了“怎么做”-19。

这个关系的理解是面试中的高频考点——很多开发者将两者混为一谈,能够清晰说出“标准 vs 实现”的关系,是加分的关键。

六、代码/流程示例演示

下面我们从零开始,开发一个智能AI答题助手。

6.1 技术栈

JDK 17 或更高版本(Spring Boot 3.x要求JDK 17+)-1

Spring Boot 3.5.x

Spring AI 1.1.2

Spring AI Alibaba 1.1.2.0

6.2 Maven依赖配置

<properties> <java.version>17</java.version> <spring-ai.version>1.1.2</spring-ai.version> </properties> <dependencyManagement> <dependencies> <dependency> <groupId>org.springframework.ai</groupId> <artifactId>spring-ai-bom</artifactId> <version>${spring-ai.version}</version> <type>pom</type> <scope>import</scope> </dependency> </dependencies> </dependencyManagement> <dependencies> <dependency> <groupId>org.springframework.boot</groupId> <artifactId>spring-boot-starter-web</artifactId> </dependency> <!-- DeepSeek模型适配器 --> <dependency> <groupId>org.springframework.ai</groupId> <artifactId>spring-ai-starter-model-deepseek</artifactId> </dependency> </dependencies> <!-- Spring Milestones仓库(必需,Spring AI部分版本在此阶段) --> <repositories> <repository> <id>spring-milestones</id> <url>https://repo.spring.io/milestone</url> </repository> </repositories>

关键说明:使用BOM(Bill of Materials)管理依赖版本是企业级项目的标准做法,确保所有Spring AI模块版本一致,避免版本冲突-11。

6.3 配置文件 application.yml

spring: application: name: ai-answer-assistant ai: deepseek: api-key: ${DEEPSEEK_API_KEY} 强烈建议使用环境变量,不要硬编码 base-url: https://api.deepseek.com chat: options: model: deepseek-chat temperature: 0.3 越低越严谨,AI答题助手建议0.2~0.5之间

Temperature参数说明:对于AI答题助手这类需要准确性、严谨性的场景,建议将temperature设置在0.2~0.5之间;如果是创意文案类场景,可以调高至0.7以上-11。

6.4 核心Service实现

@Service @Slf4j public class AIAnswerAssistantService { private final ChatClient chatClient; // 构造器注入(Spring Boot 3.x最佳实践) public AIAnswerAssistantService(ChatClient.Builder builder) { this.chatClient = builder .defaultSystem(""" 你是专业的AI答题助手,擅长解答技术类问题。 回答要求: 1. 准确无误,避免模糊表述 2. 条理清晰,分点回答 3. 适当举例说明 4. 如果不确定,请明确告知用户并给出建议 """) .build(); } // 普通问答 public String answerQuestion(String question) { log.info("收到问题: {}", question); return chatClient.prompt() .user(question) .call() .content(); } // 带历史上下文的问答(多轮对话) public String answerWithHistory(String question, List<Message> history) { Prompt prompt = new Prompt(history); prompt.getInstructions().add(new UserMessage(question)); ChatResponse response = chatClient.prompt(prompt).call(); return response.getResult().getOutput().getContent(); } // 流式问答(打字机效果) public Flux<String> streamAnswer(String question) { return chatClient.prompt() .user(question) .stream() .content(); } }

6.5 Controller暴露API

@RestController @RequestMapping("/api/assistant") public class AIAnswerAssistantController { @Resource private AIAnswerAssistantService assistantService; // 同步问答 @GetMapping("/ask") public ResponseEntity<String> ask(@RequestParam String question) { String answer = assistantService.answerQuestion(question); return ResponseEntity.ok(answer); } // 流式问答(SSE) @GetMapping(value = "/stream", produces = MediaType.TEXT_EVENT_STREAM_VALUE) public Flux<String> stream(@RequestParam String question) { return assistantService.streamAnswer(question); } }

6.6 执行流程解读

客户端请求:用户发送GET请求

/api/assistant/ask?question=什么是Spring AIController接收:请求进入

AIAnswerAssistantControllerService调用:

AIAnswerAssistantService通过ChatClient发起调用Prompt构建:

ChatClient自动将系统提示词+用户问题组装成Prompt对象模型调用:底层

ChatModel实现(DeepSeekChatModel)将Prompt转换为HTTP请求发送至DeepSeek API响应解析:DeepSeek返回JSON响应,Spring AI自动解析并提取

content字段返回客户端:答案以字符串形式返回

一次完整调用示意:

用户: "什么是Spring AI" ↓ Controller接收 → Service.answerQuestion() ↓ ChatClient自动构建Prompt: System: "你是专业的AI答题助手..." User: "什么是Spring AI" ↓ DeepSeek API调用 (HTTP POST) ↓ 响应: "Spring AI是Spring官方推出的..." ↓ 返回客户端

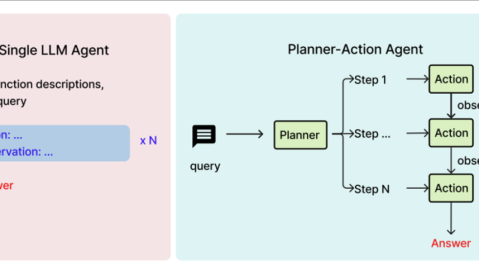

七、底层原理/技术支撑点

7.1 核心依赖关系

Spring AI Alibaba构建在Spring AI框架之上,底层依赖关系如下-3:

spring-ai-commons:提供核心抽象(Message、ChatModel、ChatClient等)spring-ai-deepseek:DeepSeek模型的适配实现spring-ai-rag:RAG检索增强支持spring-ai-retry:重试机制spring-ai-client-chat:Chat客户端抽象

版本方面,Spring AI Alibaba 1.1.2.0基于Spring AI 1.1.2和Spring Boot 3.5.8构建-48-3。

7.2 自动配置机制(面试重点)

Spring Boot的自动配置(Auto-Configuration) 是Spring AI Alibaba实现“零配置即可用”的核心机制-19。

当你在pom.xml中添加spring-ai-starter-model-deepseek依赖后:

Spring Boot启动时,会扫描

META-INF/spring/org.springframework.boot.autoconfigure.AutoConfiguration.imports文件中注册的自动配置类自动配置类读取

application.yml中的spring.ai.deepseek.配置项条件注解(如

@ConditionalOnClass、@ConditionalOnProperty)判断是否满足初始化条件若满足条件,自动实例化

DeepSeekChatModelBean并注入Spring容器ChatClient.Builder在构造时会自动从容器中获取ChatModel实例

这也是Spring AI能够实现“一行代码切换模型”的根本原因——不同厂商的Starter各自实现了同一套接口,依赖替换后自动配置机制会自动完成模型实现的切换。

八、高频面试题与参考答案

面试题1:Spring AI与Spring AI Alibaba有什么区别?

参考答案(踩分点:标准 vs 实现、JDBC类比):

Spring AI是Spring官方推出的AI框架标准,定义了

ChatModel、ChatClient、Prompt、Message等核心抽象接口,类似JDBC规范。Spring AI Alibaba是Spring AI在阿里云平台的具体落地实现,提供了与DashScope(百炼平台)深度集成的Starter和自动配置,类似于MySQL驱动。

关系可概括为“标准 vs 实现”,即Spring AI定义了“做什么”,Spring AI Alibaba实现了“怎么做”。

面试题2:ChatModel和ChatClient有何区别?分别用在什么场景?

参考答案(踩分点:底层 vs 高级、封装层级):

ChatModel是底层接口,直接与AI模型交互,需要开发者自行管理

Message的构建和组装,适合需要精细控制调用细节的场景。ChatClient是

ChatModel的高级封装,提供了默认系统提示词、记忆管理、Advisor增强链等企业级能力,代码更简洁,适合大多数业务开发场景。推荐使用ChatClient进行企业级开发,它让调用大模型变得像操作

JdbcTemplate一样简单。

面试题3:Spring AI如何实现不同厂商模型的统一调用?

参考答案(踩分点:抽象接口 + 自动配置 + 适配器模式):

抽象接口:Spring AI定义了统一的

ChatModel接口,所有模型适配器都必须实现该接口。适配器模式:每个厂商(OpenAI、DeepSeek、通义千问等)提供各自的Starter,内部实现将厂商特有的API协议转换为Spring AI的统一抽象。

自动配置:Spring Boot的条件化自动配置机制,根据

application.yml中的配置项(如spring.ai.deepseek.api-key)自动实例化对应的模型实现。这三大机制共同实现了“接口不变、实现可换”的目标。

面试题4:流式调用(Streaming)是如何实现的?底层用了什么技术?

参考答案(踩分点:Reactor、Flux、SSE):

Spring AI的流式调用通过Reactor响应式编程框架实现,返回类型为

Flux<String>。底层利用SSE(Server-Sent Events,服务器推送事件) 协议,允许服务器持续向客户端推送数据块,模拟“打字机效果”。

Flux是一个异步非阻塞的多值发布者,模型每生成一个token就通过Flux推送给客户端,而不是等完整回复生成后再一次性返回,大幅提升了用户体验。

面试题5:如何确保生产环境中API Key的安全性?

参考答案(踩分点:环境变量、配置中心、密钥管理):

禁止硬编码:绝对不能将API Key直接写在

application.yml中提交到代码仓库。环境变量:使用

${DEEPSEEK_API_KEY}占位符,通过操作系统环境变量注入。配置中心:生产环境推荐使用Nacos、Apollo等配置中心动态管理敏感配置,并配合Spring AI Alibaba的Nacos动态配置模块实现配置热更新-13。

密钥管理服务:对于更高安全要求的场景,可使用阿里云KMS(密钥管理服务)或Vault等专业密钥管理工具。

九、结尾总结

核心知识点回顾

| 知识点 | 核心结论 |

|---|---|

| Spring AI vs Spring AI Alibaba | 标准 vs 实现,类似JDBC规范 vs MySQL驱动 |

| ChatModel vs ChatClient | 底层接口 vs 高级封装,企业开发推荐ChatClient |

| 统一调用的核心机制 | 抽象接口 + 适配器模式 + 自动配置 |

| 流式调用 | Reactor + SSE,返回Flux实现打字机效果 |

| 生产安全 | 环境变量/配置中心管理API Key,禁止硬编码 |

重点与易错点

不要把API Key硬编码:这是安全红线,面试必问。

理解而非死记:重点在于理解Spring AI的“统一抽象”思想,而不仅仅是会配置。

区分ChatModel和ChatClient的职责边界:

ChatModel负责底层通信,ChatClient负责便捷封装和增强。Temperature参数需要根据场景调整:答题类场景建议低值(0.2-0.5),创意类可高值。

进阶预告

本文讲解了Spring AI Alibaba集成DeepSeek的基础用法和核心原理。下一篇文章将深入探讨:

RAG检索增强生成:让AI答题助手能够检索企业知识库,给出更准确的答案

Tool Calling工具调用:让模型能够调用外部API(如天气查询、数据库查询)

Multi-Agent多智能体协同:多个AI Agent分工协作,处理复杂任务

生产级高并发优化:缓存、限流、熔断、降级的完整工程实践

本文内容基于Spring AI Alibaba 1.1.2.0和Spring AI 1.1.2,代码示例可在此基础上直接运行。如有技术问题,欢迎在评论区交流讨论。