在各类AI助手陪聊应用爆发式增长的今天,用户发送一条消息到收到智能回复,背后往往涉及多个服务间的快速通信。这套支撑海量并发请求的“幕后功臣”,正是远程过程调用(RPC,Remote Procedure Call)框架及其高性能实现——gRPC。许多开发者能熟练调用相关API,但面对“如何设计一个支持高并发的陪聊系统后端”时,常陷入“只会用、不懂原理”的困境:混淆RPC与HTTP的关系、说不清gRPC为何更高效、面试时答不出底层序列化与协议细节。本文将从传统调用方式的痛点切入,讲清RPC核心思想,对比gRPC这一具体实现,并通过代码示例与高频面试题,帮你建立从概念到落地的完整知识链路。

一、痛点切入:为什么需要RPC?

在单体应用中,一个函数调用本地另一个函数,简单直接。但在微服务架构下,AI模型推理服务、对话历史存储服务、用户画像服务可能运行在不同的服务器上。传统的做法是通过HTTP RESTful API进行服务间调用:

传统HTTP调用方式(伪代码)import requests def get_ai_reply(user_input): 需要手动构造URL、序列化JSON、处理响应状态码 response = requests.post( "http://ai-model-service/v1/chat", json={"query": user_input}, headers={"Content-Type": "application/json"} ) if response.status_code == 200: return response.json()["reply"] else: raise Exception("Call failed")

传统方式的缺点:

耦合度高:调用方需要硬编码服务地址、协议细节(如

/v1/chat路径)。扩展性差:服务地址变更或增加新接口时,调用方代码需多处修改。

性能冗余:HTTP协议头部臃肿,JSON序列化效率较低,不适合低延迟场景。

缺乏治理:无内置负载均衡、熔断、超时控制等能力,需自行实现。

为了像调用本地函数一样调用远程服务,同时屏蔽网络通信的复杂性,RPC思想应运而生。

二、核心概念讲解:RPC(远程过程调用)

定义:RPC(Remote Procedure Call,远程过程调用)是一种计算机通信协议,允许程序调用另一个地址空间(通常位于另一台机器上)的过程或函数,而开发者无需显式编码网络交互细节。

关键词拆解:

远程:区别于本地函数调用,目标函数位于不同进程或机器。

过程:指函数或方法。

调用:保持本地调用般的语法和语义(同步等待返回结果)。

生活化类比:

你去餐厅吃饭,只需对服务员说“点一份宫保鸡丁”(本地调用),而无需关心后厨厨师(远程服务)如何洗菜、切菜、炒菜,更无需自己把食材送进厨房、等待、端菜。服务员扮演了RPC框架的角色,帮你完成了“菜单序列化”“传菜请求”“等待结果返回”等一系列复杂操作。

作用与价值:

将网络通信细节(连接管理、数据序列化、错误重试)对开发者透明化。

使分布式系统编程体验接近本地函数调用,提升开发效率。

便于服务拆分与独立部署,支撑微服务架构。

三、关联概念讲解:gRPC

定义:gRPC(gRPC Remote Procedure Call)是Google开源的高性能RPC框架,基于HTTP/2协议设计,默认使用Protocol Buffers(Protobuf)作为接口定义语言(IDL)和数据序列化格式。

它与RPC的关系:

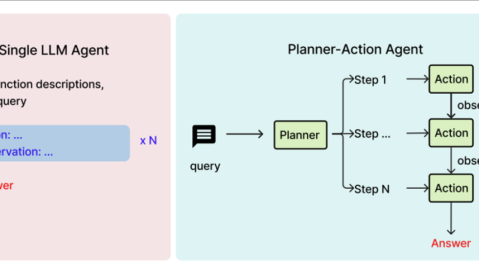

RPC是一种设计思想或协议规范,而gRPC是这种思想的具体实现之一。类似“排序算法”与“快速排序”的关系:前者是抽象概念,后者是可运行的代码库。

对比差异(RPC vs gRPC):

| 维度 | RPC(概念) | gRPC(具体实现) |

|---|---|---|

| 协议 | 未规定,可使用TCP/UDP/HTTP | 基于HTTP/2 |

| 序列化 | 未规定,可自定义 | Protobuf(二进制,高性能) |

| 跨语言 | 依赖具体实现 | 官方支持C++/Java/Python/Go等12+语言 |

| 流式传输 | 未规定 | 支持客户端流、服务端流、双向流 |

| 治理能力 | 无内置 | 内置负载均衡、健康检查、拦截器等 |

简单示例说明运行机制:

使用

.proto文件定义服务接口和数据结构。通过gRPC提供的编译器生成客户端和服务器端代码。

客户端调用生成的方法,框架自动将请求序列化为Protobuf二进制,通过HTTP/2帧发送。

服务端反序列化请求,执行业务逻辑,返回结果。

四、概念关系与区别总结

一句话记忆:RPC是“打电话”这个想法,gRPC是具体的“4G/5G电话实现”——前者定义了远程调用的思想,后者规定了用哪种协议、如何编码、怎样传输。

逻辑关系:

思想 vs 实现:RPC是设计理念,gRPC是遵循该理念的成熟框架。

整体 vs 局部:RPC涵盖完整调用范式,gRPC侧重高性能、跨语言场景。

设计 vs 落地:理解RPC让你明白“为什么能像本地调用”,掌握gRPC让你知道“具体怎么写代码”。

易混淆点澄清:

不要将RPC与HTTP简单对立。gRPC恰恰是基于HTTP/2实现的RPC。传统的HTTP API(如RESTful)也可以看作是一种非标准的、自描述的RPC实现,但缺乏类型安全和高效序列化。

五、代码示例:从传统HTTP调用到gRPC实现

我们模拟一个AI陪聊服务的简单后端:客户端发送用户消息,服务端返回回复。

步骤1:定义Protobuf文件(chat.proto)

syntax = "proto3"; package ai.chat; // 定义请求消息结构 message ChatRequest { string user_input = 1; // 用户输入文本 } // 定义响应消息结构 message ChatReply { string ai_response = 1; // AI回复文本 } // 定义服务 service ChatService { rpc GetReply (ChatRequest) returns (ChatReply); }

步骤2:生成代码并实现服务端(Python示例)

生成的代码省略,重点看业务实现 import grpc from concurrent import futures import chat_pb2 import chat_pb2_grpc class ChatServicer(chat_pb2_grpc.ChatServiceServicer): def GetReply(self, request, context): 模拟AI处理逻辑(可调用真实模型) user_msg = request.user_input reply_text = f"AI收到: '{user_msg}',这是模拟回复。" return chat_pb2.ChatReply(ai_response=reply_text) def serve(): server = grpc.server(futures.ThreadPoolExecutor(max_workers=10)) chat_pb2_grpc.add_ChatServiceServicer_to_server(ChatServicer(), server) server.add_insecure_port('[::]:50051') server.start() print("gRPC服务启动在50051端口") server.wait_for_termination()

步骤3:实现客户端

import grpc import chat_pb2 import chat_pb2_grpc def run(): channel = grpc.insecure_channel('localhost:50051') stub = chat_pb2_grpc.ChatServiceStub(channel) response = stub.GetReply(chat_pb2.ChatRequest(user_input="你好,AI!")) print(f"AI回复: {response.ai_response}")

对比改进效果:

调用方式:

stub.GetReply(request)看起来就像本地函数调用。性能:Protobuf二进制序列化体积比JSON小约30%~50%,HTTP/2支持多路复用,减少连接开销。

类型安全:

.proto文件自动生成强类型代码,避免手写JSON字段名拼写错误。扩展性:增加新接口只需扩展

.proto并重新生成代码。

六、底层原理与技术支撑

gRPC能够实现高效远程调用的底层依赖:

HTTP/2协议:多路复用(单一连接并发处理多个请求)、头部压缩(HPACK算法)、服务端主动推送。相比HTTP/1.1,解决了队头阻塞问题。

Protocol Buffers:使用Varint、Zigzag等编码算法,将结构体数据编码为紧凑的二进制流。字段编号(field number)替代字段名,大幅减少传输体积。

反射与动态代理(Java/C等语言):客户端Stub利用动态代理或代码生成技术,拦截方法调用,将参数序列化并封装成网络请求。服务端通过反射或预生成的分发代码,将请求路由到具体方法。

Netty(Java版本):底层异步网络通信框架,基于NIO(非阻塞I/O)模型,支撑高并发连接。

这些底层技术共同支撑了gRPC上层“像本地调用一样简单”的假象,同时也解释了为何它比传统HTTP API更适合低延迟、高吞吐的AI陪聊等服务。

七、高频面试题与参考答案

Q1:RPC和HTTP有什么区别?

参考答案:

概念层级:RPC是一种调用范式/思想,HTTP是一种应用层协议。RPC可以通过HTTP协议实现(如gRPC),也可以使用TCP自定义协议。

使用方式:RPC旨在让远程调用像本地函数一样,接口与业务模型耦合紧密;HTTP API(如RESTful)更侧重资源操作,通过URL和动词表达意图。

性能:通用RPC框架(如gRPC)使用二进制序列化(Protobuf)和连接复用,通常比基于JSON的HTTP/1.1 API性能更高。

跨语言:RPC框架需专门提供IDL和代码生成工具来支持多语言;HTTP API天然通过文本格式(JSON/XML)实现跨语言,但缺乏类型安全。

Q2:gRPC为什么比传统HTTP API快?

参考答案:

序列化:Protobuf二进制编码体积小、解析速度快,相比JSON/XML节省网络带宽和CPU时间。

协议层:基于HTTP/2,支持多路复用,一个TCP连接可并发处理多个请求,避免频繁握手;头部压缩减少冗余数据。

传输模式:支持流式传输(客户端流、服务端流、双向流),在某些场景下可降低请求延迟。

连接管理:长连接复用,减少TCP连接建立开销。

Q3:gRPC支持的四种服务模式是什么?

参考答案:

简单RPC(Unary):客户端发送一个请求,服务端返回一个响应,如普通函数调用。

服务端流式(Server Streaming):客户端发送一个请求,服务端返回一个消息序列(流),客户端持续读取直到结束。适用于推送事件、大文件分块返回。

客户端流式(Client Streaming):客户端发送一个消息序列,服务端返回一个响应。适用于上传大文件、批量数据提交。

双向流式(Bidirectional Streaming):双方独立地发送和接收消息序列,可交错进行。适用于实时聊天、在线游戏等场景。

Q4:如何保证gRPC调用的可靠性?

参考答案:

gRPC本身提供超时(deadline/timeout)、重试(retry)机制和截止时间传播。生产环境中通常还需结合:

负载均衡:客户端侧负载均衡(如gRPC自带的

pick_first、round_robin)或通过代理(如Envoy)。健康检查:gRPC内置健康检查协议(

grpc.health.v1.Health),可配合服务发现组件。拦截器(Interceptor):实现统一的日志、监控、鉴权、熔断逻辑。

命名解析(Name Resolution):与服务发现系统(Consul、etcd、ZooKeeper)集成,动态更新服务端点。

八、结尾总结

本文围绕AI助手陪聊这一典型场景,梳理了从RPC思想到gRPC实现的完整知识链路。核心要点回顾:

痛点:传统HTTP调用耦合度高、性能冗余,催生了RPC思想。

RPC:远程过程调用的设计范式,让跨进程调用如同本地函数。

gRPC:高性能RPC实现,基于HTTP/2 + Protobuf,提供跨语言、流式传输等能力。

关系:RPC是思想,gRPC是落地产品之一,类似“接口与实现”。

代码:通过

.proto定义,自动生成强类型Stub,调用方式简洁。底层:依赖HTTP/2、Protobuf编码、动态代理/反射等技术。

面试要点:区分RPC与HTTP、gRPC高性能原因、四种服务模式、可靠性保障手段。

易错点提示:不要混淆RPC与具体实现(如gRPC、Dubbo、Thrift);不要认为gRPC只支持简单RPC(它支持流式);不要忽略底层HTTP/2协议带来的性能收益。

下一篇我们将深入gRPC的流式传输实现原理,并结合真实AI模型推理服务,展示如何构建一个支持高并发聊天的完整后端系统。如果你对“如何设计拦截器实现全链路监控”或“gRPC与Kubernetes的深度集成”感兴趣,欢迎留言讨论。

本文旨在提供清晰的技术理解与实战引导,示例代码已简化核心逻辑,可直接复制运行体验。